Fonctionnement de la numérisation d’un signal analogique audio

Je vais y aller doucement ….sans formules ou presque. Le sujet du Fonctionnement de la numérisation d’un signal analogique audio est complexe.

je voudrai que vous le trouviez fastoche …

Mais d’abord ?

Que se passe-t-il entre votre voix, votre micro et les enceintes ?

Bien comprendre ce fonctionnement vous permettra de mieux choisir votre matériel audio notamment votre micro, votre casque, votre carte son (La focusrite scarlett par exemple) vous aurez mieux comparer et comprendre les différences et juger de la qualité d’un son numérique.

Le passage de votre voix en tant qu’onde sonore jusqu’à votre voix en tant que fichier audio … voila le sujet .

sommaire

- Une onde sonore kesako ?

- Analogique ca veut dire quoi ?

- l’amplitude

- la fréquence

- L’échantillonnage

- Quantification:

- Codage

- conclusion

Une onde vous voyez ce que c’est ?

Ces petites vaguelettes qui se dessinent au dessus de l’eau lorsque vous jetez un caillou dans le lac ? Et bien c’est une onde. Dans l’air c’est la même chose mais ça se voit moins facilement car indirectement.

dans cet article j’aborde la transformation de cette onde en un fichier numérique. Avec pour objectif : quand vous choisissez du matériel vous savez mieux ce que vous faites.

Rien que ça

Pour faire simple, le Fonctionnement de la numérisation d’un signal analogique audio est le processus de conversion d’un signal analogique en un signal numérique.

Mais d’abord , analogique ca veut dire quoi ?

Votre voix ( mais c’est identique avec son musical) se déplace dans l’espace comme une onde ….. qui ondule. Pour représenter une onde on utilise un graphique sous forme de signal, comme ci dessous.

Ce signal représente (il s’agit d’un modèle de représentation) d’une façon analogue (identique) l’onde sonore. voila pourquoi on l’appelle analogique.

Ce signal a des propriétés:

L’amplitude c’est tout simplement la force du son : Il y a une notion de pression acoustique derrière . un son fort a une forte amplitude , par exemple, un cri, un tambour, un avion…

Donc si je comprend bien, l’amplitude c’est la hauteur du signal, l’intensité du son, l’énergie du son ? J’ai bon ? Yes

L’amplitude on a besoin de lui donner une valeur. on a choisi de la nommer en décibels. C’est une pression acoustique . pression au sens mécanique.

Maintenant, Vous avez entendu parlé de fréquence ? aigu, grave ca vous parle ?

Maintenant, Vous avez entendu parlé de fréquence ? aigu, grave ca vous parle ?

Et bien la fréquence c’est la vitesse ou la lenteur de la vague du signal sur une période de temps donnée.

C’est simple.

Une vague très resserrée vibre rapidement et une vague ronde et basse vibre peu. Si le son est aigu, l’onde vibre beaucoup ( à droite sur le graphique ) et si le son est grave, le signal s’étale ( à gauche sur le graphique).

C’est notre point numéro 2 , la longueur d’onde. Elle est liée a la fréquence.

Normalement vous pourriez le trouver tout seul .

Si une fréquence aigue c’est une vague très resserrée ca signifie que la notion de fréquence est liée au nombre d’oscillations par période de temps.

Là je suis obligé de sortir quelques chiffres mais je le fais au minimum.

Si je prend une période de une 0,1 seconde ( voir graphique ci-contre), alors la fréquence est le nombre d’oscillations en une seconde. ici il y 4 oscillations pour 0,1 seconde, donc 40 oscillations pour 1 seconde. la fréquence du signal est donc de : 40 hertz

Pour résumer

- Amplitude : ca veut dire énergie, force, hauteur en décibels

- Fréquence ca veut dire : nombre de hauts et de bas identiques (oscillations) en 1 seconde , en Hertz

Test QCM: Plus le signal est complexe, plus l’échantillonnage doit être rapproché Oui ou Non ? ((réponse en bas de l’article)

Ca va encore ? Vous suivez ?

Pour avancer dans le Fonctionnement de la numérisation d’un signal analogique audio, on va parler de la numérisation d’un son.

La numérisation consiste à transformer un signal analogique qui contient une quantité infinie de valeurs (amplitude et fréquence) en un signal numérique contenant, lui, une quantité finie de valeurs. Le signal analogique signifie analogue ou identique à l’onde sonore de votre voix.

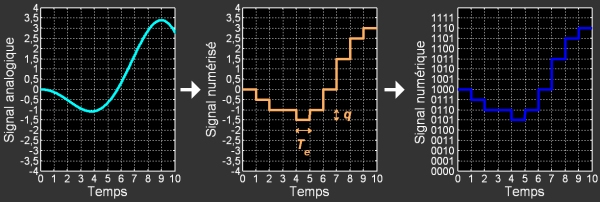

Et le passage de l’analogique au numérique repose sur trois étapes successives : l’échantillonnage, la quantification, et le codage.

- échantillonnage

- quantification

- codage

L’échantillonnage

Pour transformer un son dit analogique en numérique, nous utilisons un processus appelé : échantillonnage.

Pour transformer un son dit analogique en numérique, nous utilisons un processus appelé : échantillonnage.

J’ai une image qui je pense éclaire bien ce qu’est l’échantillonnage.

Pour comprendre comment un ordinateur représente le son on peut se référer à la

façon donc le cinéma représente l’image en mouvement. Vous faites défiler une vidéo ( qui représente le signal analogique) et vous faites des screens de la vidéo à des intervalles de temps définis. Chaque screen représente un pas d’échantillonnage auquel on attribue une valeur unique de l’amplitude (maintenant vous savez de que c’est). on passe donc d’une courbe continue (le flux analogique) à un flux discontinu ( en forme de paliers ).

Deux paramètres caractérisent un son échantillonné : la qualité et la résolution.

La qualité du son numérique est liée directement au nombre d’échantillons prélevés par unité de temps. Plus on prélève d’échantillons par unité de temps et par conséquent meilleure est la qualité.

Sur la même période de temps, à gauche le nombre de prélèvements est supérieur au le nombre de prélèvements du signal de droite. Donc le son sera de meilleure qualité a gauche.

Le nombre des échantillons recueillis doit permettre de pouvoir reconstruire le signal d’origine.

En effet, on part d’un signal analogique (un micro avec votre voix ) , on convertit ce signal en valeurs numériques , puis pour réécouter le signal dans une enceinte ou un casque on a besoin à nouveau d’un signal analogique. Pour que l’écoute dans l’enceinte ou le casque soit conforme au signal initial ( votre voix dans le micro) , le nombre des échantillons doit être au minimum du double de la fréquence maximale audible qui est reconnue être de 20 000 Hertz.

C’est le critère de Shannon

La fréquence d’échantillonnage doit être au minimum égale ou supérieure à deux fois la fréquence la plus élevée du signal que l’on veut coder. Or l’oreille humaine entend jusqu’à environ 20 000 Hertz. La fréquence d’échantillonnage doit être donc de 40 000 hertz.

La gamme de fréquences audibles « normale » est comprise entre 20 Hz et 20 000 Hz pour une personne en bonne santé. En effet les fichiers audio sont couramment échantillonnés à 44,1 kHz, car cela permet de restituer des sons dont la fréquence peut aller jusqu’à 22,05 kHz, c’est-à-dire un peu au-delà de la fréquence maximale audible par l’Homme (20 kHz).

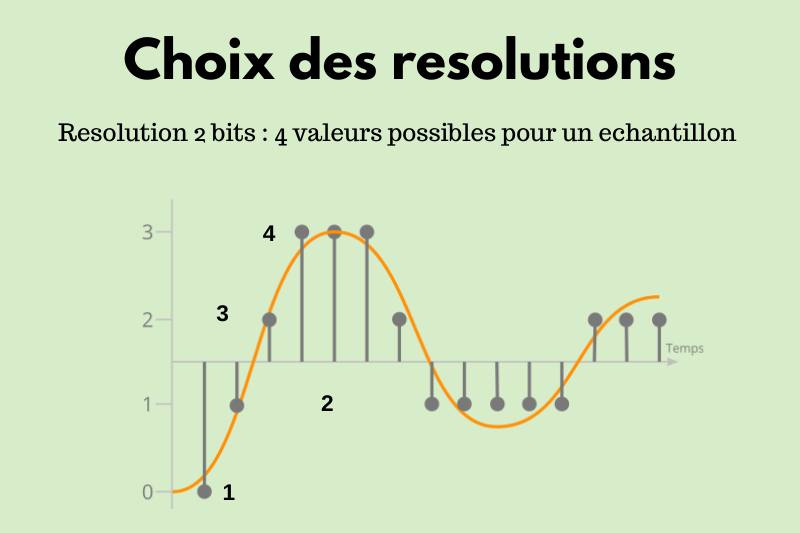

La résolution:

A chaque échantillon ( qui remplace l’amplitude du son analogique), on va attribuer une valeur numérique, c’est a dire un nombre. Ce nombre est binaire. Il est constitue de 0 et de 1 .

A chaque échantillon ( qui remplace l’amplitude du son analogique), on va attribuer une valeur numérique, c’est a dire un nombre. Ce nombre est binaire. Il est constitue de 0 et de 1 .

La résolution c’est le choix du nombre de bits permettant de donner une plage de valeur a un échantillon.

En général, on utilise des valeurs de 8, 16 ou 24 bits pour numériser un signal audio. Plus la valeur en bits est élevée, plus la précision de la numérisation est élevée.

Une résolution de 8 bits permettra de donner a chaque échantillon une valeur entre 0 et 2 puissance 8 (28) soit 256 valeurs. On doit créer un signal électrique qui reproduit le signal analogique. c’est du courant électrique qui se balade dans le câble XLR. et chaque échantillon possède une tension en Volts correspondant à une valeur de 0 et 1 choisie dans une plage de 258 – 1 valeurs

Une résolution de 8 bits permettra de donner a chaque échantillon une valeur entre 0 et 2 puissance 8 (28) soit 256 valeurs. On doit créer un signal électrique qui reproduit le signal analogique. c’est du courant électrique qui se balade dans le câble XLR. et chaque échantillon possède une tension en Volts correspondant à une valeur de 0 et 1 choisie dans une plage de 258 – 1 valeurs

Pour bien comprendre l’importance de la résolution, voici le schéma a gauche qui représente pour un choix d’échantillonnage de 2 bits, comment sont attribuées les 4 valeurs possibles aux échantillons.

Si on passe a 8 bits on aura 256 positions des échantillons sur le signal.

La plage dynamique:

Un élément important pour avancer dans le Fonctionnement de la numérisation d’un signal analogique audio est la qualité de la numérisation.

Un élément important pour avancer dans le Fonctionnement de la numérisation d’un signal analogique audio est la qualité de la numérisation.

Plus votre plage dynamique sera importante, plus vous pouvez obtenir un son numérisé de bonne qualité. Tous autres choix corrects par ailleurs .

La plage dynamique correspond a une puissance sonore.

Le choix d’une résolution (en bits) entraine une tension électrique (en Volts) plus ou moins enlevée au niveau de chaque échantillon. Plus la tension sera élevée, plus on aura de puissance de son a la sortie au niveau de l’écoute ( casque ou enceintes).

Il est intéressant de faire un parallèle entre le type de musique ( voix simple ou concert symphonique) et la plage dynamique nécessaire. Ainsi on peut déterminer la résolution minimale utile des échantillons.

Pour un signal audio de qualité CD standard, la valeur en bits est de 16 bits. Cela signifie que chaque échantillon du signal audio est numérisé sur 16 bits, ce qui donne une plage dynamique de 96 dB. Pour des enregistrements professionnels, on peut utiliser des valeurs de 24 bits, ce qui permet d’obtenir une plage dynamique plus large.

Une résolution de 16 bits correspond a une plage dynamique de 96 dB. Cette résolution permet donc de fournir une puissance sonore suffisante pour toutes les configurations musicales.

Quantification:

Le choix de la résolution (ex 16 bits ou (216) valeurs différentes possibles à donner à un échantillon du signal est liée à la plage dynamique du signal. Une résolution de 16 bits donne une plage dynamique de 96 dB.

Est ce suffisant ?

L’oreille humaine peut en général entendre sur le spectre suivant : 20 Hz – 20 000 Hz. .On choisira donc un échantillonnage minimum de 2 fois la fréquence de l’écoute humaine soit 40 000 hertz. C’est pourquoi la résolution de 44 100 Hz est la plus utilisée car elle permet de couvrir le spectre jusqu’à 22 050 Hz. Par contre utiliser un échantillonnage supérieur na pas d’intérêt dans la mesure ou votre oreille sera incapable d’entendre la différence.

On pourrait donc utiliser un échantillonnage de 44100 Hz et une quantification de 16 bits pour numériser le signal.

En réalité le choix de 16 bits possède des limites.

Il vaut mieux prendre une résolution de 24 bits . Pourquoi ?

Le niveau de bruit en 24 bits est inferieur qu’en 16 bits pour la même fréquence d’échantillonnage

Qu’est ce que le bruit ?

Le bruit est un signal qui vient perturber le signal analogique original.

le bruit de quantification diminue si le nombre de valeurs possibles données aux échantillons augmente. Donc le signal numérique sera moins bruyant en 24 bits qu’en 16 bits. bien sur il est possible de réduire le bruit en post production mais cela est difficile pour des signaux complexes.

un autre problème peut intervenir : c’est la saturation du son. en effet , si le nombre de valeurs de la quantification n’est pas suffisante, il y aura un écrêtage du signal qui aura pour conséquences une distorsion du signal qu’on appelle saturation.

Le codage :

autre source très intéressante pour appréhender le Fonctionnement de la numérisation d’un signal analogique audio et les choix a effectuer dans le domaine de la numérisation pour l’enregistrement ou la lecture ( écoute sur enceintes)

Conclusion:

La conversion d’un signal analogique en signal numérique correspond à 3 étapes :

Echantillonnage : la valeur du signal n’est mesurée que périodiquement. Le temps entre deux mesures consécutives est la période d’échantillonnage , son inverse est la fréquence d’échantillonnage . Celle-ci doit être au moins deux fois plus grande que la fréquence la plus forte composant le signal, selon le théorème de Shannon.

Quantification : les valeurs mesurées sont arrondies, afin que le signal numérisé ne prenne qu’un nombre fini de valeurs différentes. Pour un convertisseur analogique-numérique (C.A.N.) n bits travaillant sur un domaine en tension , la résolution du convertisseur est . C’est l’écart entre deux valeurs permises consécutives.

Codage : Pour sa transmission, le signal numérisé est codé en binaire, c’est-à-dire en base 2. Un nombre binaire est composé de chiffres binaires, les bits (0 ou 1).

Réponse du QCM : Plus le signal est complexe, plus l’échantillonnage doit être rapproché ? Oui car plus le signal possède une forme toujours changeante, plus il faut de prélèvements du signal afin de reproduire le signal original

Laissez un commentaire